چرا افزایش پهنای باند همیشه مشکل شبکه را حل نمیکند؟

در بسیاری از پروژههای زیرساختی، اولین واکنش مدیران IT در مواجهه با کندی شبکه، قطعیهای مقطعی یا تأخیر در انتقال دادهها این است که پهنای باند اینترنت یا لینکهای داخلی را افزایش دهند. این تصمیم در ظاهر منطقی است؛ چون تصور میشود هرچه ظرفیت لینک بالاتر باشد، عملکرد شبکه بهتر خواهد شد. اما تجربههای عملی در دیتاسنترها، سازمانهای متوسط و حتی شبکههای کوچک نشان میدهد که افزایش پهنای باند شبکه همیشه راهحل قطعی نیست. گاهی مشکل نه در سرعت لینک، بلکه در معماری داخلی تجهیزات، ظرفیت پردازش سوئیچ و محدودیتهای Backplane نهفته است.

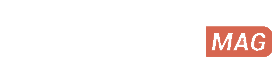

برای درک این موضوع، باید به لایهای عمیقتر از شبکه نگاه کنیم؛ جایی که Switching Capacity و Backplane تعیین میکنند دادهها چگونه بین پورتها جابهجا شوند. در بسیاری از موارد، شبکه از بیرون پرسرعت به نظر میرسد، اما در داخل تجهیزات دچار گلوگاه است.

افزایش پهنای باند شبکه؛ راهحل ساده برای مسئلهای پیچیده

وقتی کاربران از کندی دانلود، قطعی VoIP یا تأخیر در سیستمهای مالی شکایت میکنند، مدیر شبکه معمولاً به سراغ ISP میرود و درخواست ارتقای لینک میدهد. مثلاً از 200Mbps به 500Mbps یا حتی 1Gbps. اما اگر مشکل در لایه Switching باشد، این ارتقا تنها هزینه را افزایش میدهد بدون آنکه بهبود ملموسی ایجاد کند.

در بسیاری از شبکههای سازمانی، ترافیک داخلی چند برابر ترافیک اینترنت است. انتقال فایل بین سرورها، دسترسی به NAS، ارتباط بین ماشینهای مجازی و حتی ترافیک Broadcast و Multicast، همگی در داخل سوئیچ جریان دارند. در این شرایط، حتی اگر اینترنت 10Gbps باشد، اما سوئیچ Core ظرفیت پردازش کافی نداشته باشد، همچنان کاربران تأخیر را احساس خواهند کرد.

اینجاست که مفهوم Switching Capacity وارد میشود.

Switching Capacity چیست و چرا اهمیت دارد؟

Switching Capacity یا ظرفیت سوئیچینگ، مجموع پهنای باندی است که یک سوئیچ میتواند بهصورت همزمان بین تمام پورتهای خود پردازش کند. این عدد معمولاً برحسب گیگابیت بر ثانیه بیان میشود و در دیتاشیت تجهیزات درج میشود. فرض کنید یک سوئیچ 48 پورت گیگابیتی دارید. اگر هر پورت بتواند 1Gbps ارسال و 1Gbps دریافت کند (Full Duplex)، مجموع تئوری پهنای باند برابر خواهد بود با:

48 × 2 × 1Gbps = 96Gbps

اگر Switching Capacity سوئیچ کمتر از این مقدار باشد، یعنی دستگاه در شرایط بار کامل دچار Oversubscription میشود. در نتیجه، حتی با وجود لینکهای پرسرعت، همه پورتها نمیتوانند همزمان با حداکثر ظرفیت کار کنند. در چنین شرایطی، افزایش پهنای باند شبکه در سطح اینترنت یا Uplink تأثیری بر گلوگاه داخلی نخواهد داشت.

نقش Backplane در عملکرد واقعی شبکه

Backplane در واقع شاهراه داخلی سوئیچ است؛ مسیری که بستههای داده از طریق آن بین پورتها منتقل میشوند. اگر Switching Capacity مغز سوئیچ باشد، Backplane ستون فقرات آن است. در سوئیچهای Enterprise، Backplane معمولاً ظرفیت بسیار بالایی دارد و اجازه میدهد ترافیک بهصورت Non-Blocking منتقل شود. اما در تجهیزات اقتصادی یا مدلهای قدیمیتر، Backplane محدود است. این یعنی حتی اگر روی هر پورت 1Gbps داشته باشید، ممکن است Backplane نتواند مجموع ترافیک را مدیریت کند.

نتیجه چه میشود؟ افزایش پهنای باند شبکه بدون توجه به ظرفیت Backplane تنها فشار بیشتری بر یک ساختار محدود وارد میکند.

مثال عملی: وقتی لینک 10G هم مشکل را حل نمیکند

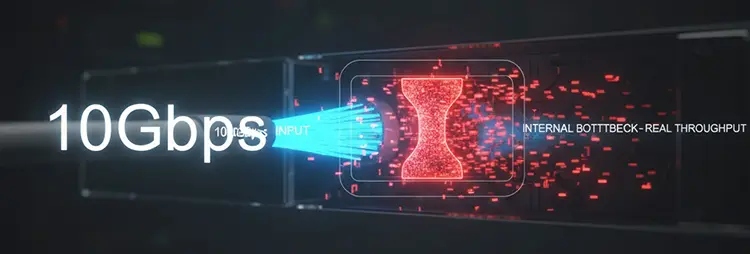

در یک سناریوی واقعی، سازمانی لینک Uplink بین Access Switch و Core را از 1G به 10G ارتقا داد. انتظار میرفت سرعت انتقال فایلها بهطور چشمگیری افزایش یابد. اما کاربران همچنان از کندی سیستمهای ERP شکایت داشتند. پس از بررسی مشخص شد که Core Switch دارای Switching Capacity پایینتر از مجموع ترافیک ورودی بود.

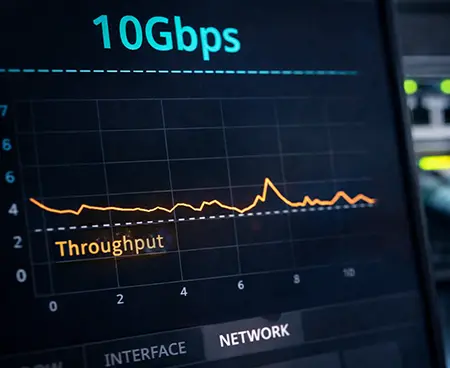

همچنین جدول MAC Address تحت فشار قرار داشت و CPU سوئیچ در ساعات اوج مصرف به بیش از 80 درصد میرسید. در این وضعیت، حتی Uplink 10G هم کمکی نکرد. این مثال نشان میدهد که افزایش پهنای باند شبکه اگر بدون تحلیل معماری انجام شود، نتیجه مطلوبی نخواهد داشت.

Oversubscription؛ دشمن پنهان عملکرد شبکه

Oversubscription زمانی رخ میدهد که مجموع ظرفیت پورتهای Access بیش از ظرفیت لینکهای Uplink یا Backplane باشد. این طراحی در برخی سناریوها قابل قبول است، اما اگر نسبت آن بالا باشد، در زمان پیک مصرف باعث افت عملکرد میشود.

برای مثال، اگر 48 کاربر هرکدام بتوانند 1Gbps تولید کنند، اما تنها یک Uplink 10G وجود داشته باشد، نسبت Oversubscription برابر 4.8:1 خواهد بود. در بار کامل، ترافیک فشرده میشود و صفهای داخلی افزایش مییابد. در چنین شرایطی، افزایش پهنای باند شبکه در سطح اینترنت هیچ تأثیری ندارد، زیرا گلوگاه در لایه داخلی است.

تفاوت Throughput واقعی با عدد روی جعبه

بسیاری از تجهیزات عددی مانند 176Gbps Switching Capacity یا 130Mpps Forwarding Rate را تبلیغ میکنند. اما این اعداد معمولاً در شرایط آزمایشگاهی و با Packet Size مشخص بهدست آمدهاند. در شبکههای واقعی، بستهها اندازههای متفاوت دارند، VLANها فعال هستند، QoS اعمال میشود و گاهی ACL یا Policy-Based Routing نیز اجرا میشود.

همه این عوامل از ظرفیت واقعی کم میکنند. بنابراین، قبل از تصمیم به افزایش پهنای باند شبکه باید بررسی شود که آیا سوئیچها توان پردازش واقعی ترافیک سازمان را دارند یا خیر.

نقش CPU و Architecture داخلی سوئیچ

در سوئیچهای لایه 2 ساده، بیشتر عملیات در ASIC انجام میشود و CPU کمتر درگیر است. اما در سوئیچهای لایه 3 که Routing، ACL، NAT یا حتی Policy اجرا میکنند، CPU اهمیت زیادی پیدا میکند. اگر CPU تحت فشار باشد، حتی با وجود Backplane قوی، Packet Processing دچار تأخیر میشود. در این حالت، مدیر شبکه ممکن است اشتباهاً تصور کند که مشکل از کمبود پهنای باند است، در حالی که مسئله در معماری داخلی دستگاه است.

چه زمانی افزایش پهنای باند شبکه واقعاً مؤثر است؟

افزایش پهنای باند شبکه زمانی مؤثر است که:

- گلوگاه در لینک WAN یا اینترنت باشد.

- تجهیزات داخلی ظرفیت کافی داشته باشند.

- CPU و حافظه دستگاهها در محدوده نرمال کار کنند.

- Oversubscription کنترل شده باشد.

اگر این شرایط برقرار نباشد، ارتقای لینک تنها یک راهحل موقت خواهد بود.

چگونه تشخیص دهیم مشکل از پهنای باند نیست؟

برای تحلیل دقیق، باید موارد زیر بررسی شود:

- بررسی Utilization پورتها در ساعات اوج مصرف

- تحلیل Packet Drop در Interfaceها

- بررسی Queue Depth و Buffer Usage

- بررسی CPU و Memory

- تحلیل Broadcast و Multicast Storm

- مقایسه Switching Capacity با مجموع ظرفیت پورتها

در بسیاری از پروژهها، پس از این تحلیل مشخص میشود که افزایش پهنای باند شبکه تنها بخش کوچکی از مسئله را پوشش میدهد.

معماری صحیح بهجای ارتقای شتابزده

گاهی بهجای افزایش پهنای باند شبکه، باید طراحی مجدد انجام شود. استفاده از معماری Three-Tier (Access, Distribution, Core) یا در شبکههای مدرنتر طراحی Spine-Leaf، میتواند ترافیک را بهصورت متوازن توزیع کند. همچنین استفاده از Link Aggregation، افزایش تعداد Uplinkها و انتخاب سوئیچ با Backplane قویتر معمولاً تأثیر بیشتری نسبت به افزایش لینک اینترنت دارد.

تأثیر مجازیسازی و ترافیک شرق به غرب

در دیتاسنترهای مدرن، بخش زیادی از ترافیک بهصورت East-West بین سرورها جریان دارد، نه North-South به سمت اینترنت. در چنین سناریویی، افزایش پهنای باند شبکه در مرز اینترنت تأثیری بر عملکرد داخلی نخواهد داشت. اگر سوئیچ ToR یا Core ظرفیت کافی برای مدیریت ترافیک VM-to-VM نداشته باشد، Bottleneck ایجاد میشود. در این شرایط، بررسی Switching Fabric اهمیت بیشتری از ارتقای لینک ISP دارد.

نقش QoS و مدیریت ترافیک

گاهی مشکل از کمبود ظرفیت نیست، بلکه از توزیع نامناسب منابع است. بدون QoS، ترافیک دانلود یا Backup میتواند لینک را اشباع کند و باعث اختلال در VoIP یا ERP شود. در این شرایط، افزایش پهنای باند شبکه ممکن است موقتاً مشکل را کاهش دهد، اما با رشد مصرف دوباره بازمیگردد. راهحل پایدار، پیادهسازی سیاستهای مدیریت ترافیک است.

خطای رایج در خرید تجهیزات

بسیاری از سازمانها هنگام خرید سوئیچ تنها به تعداد پورت و سرعت هر پورت توجه میکنند. در حالی که پارامترهایی مانند:

Switching Capacity

Forwarding Rate

Backplane Bandwidth

Buffer Size

Latency

نقش حیاتی در عملکرد دارند.

نادیده گرفتن این موارد باعث میشود مدیران بعدها به اشتباه تصور کنند که باید افزایش پهنای باند شبکه انجام دهند، در حالی که مشکل از ابتدا در انتخاب سختافزار بوده است.

جمعبندی: نگاه مهندسی به مسئله ظرفیت

افزایش پهنای باند شبکه همیشه وسوسهکنندهترین راهحل است، چون ساده و سریع به نظر میرسد. اما شبکه یک سیستم چندلایه است که عملکرد آن به معماری داخلی تجهیزات وابسته است. Switching Capacity و Backplane تعیین میکنند دادهها با چه سرعتی در داخل سوئیچ جابهجا شوند. اگر این ظرفیت محدود باشد، حتی سریعترین لینکها نیز نمیتوانند مشکل را برطرف کنند. راهحل اصولی، تحلیل دقیق ترافیک، بررسی طراحی شبکه، ارزیابی ظرفیت واقعی تجهیزات و در صورت لزوم ارتقای معماری است؛ نه صرفاً افزایش عدد پهنای باند. در نهایت، مهندسی شبکه یعنی تشخیص گلوگاه واقعی. گاهی این گلوگاه در اینترنت است، اما بسیاری از مواقع در قلب سوئیچ پنهان شده است.